- 会社でChatGPTを利用したいんだけど、情報流出の可能性があるの?

- 安全に使うための対策はないの?

会社で普段からChatGPTを使っている方や、今後使おうと思っている方が心配にしているのがChatGPTによる情報流出ですよね?

情報セキュリティーの重要性が叫ばれる昨今、機密情報の取り扱いには特に敏感にならなければなりません。

ただ、結論から言うと、ChatGPTは正しく使うことが出来れば、情報流出が起こる可能性は極めて低いです。

そこで今回は、そもそもなぜ情報流出が起こるのか?といった仕組みから、実際の事例、安全に使う方法まで幅広く紹介していきます。

ChatGPTのセキュリティ面は危険なのか?データ保護ポリシーを徹底調査

そもそもChatGPTは危険なサービスなのか?という点について紹介します。

まず結論から言うと、ChatGPTの運営であるOpenAI社は、かなりプライバシーセキュリティーに力を入れている企業であるため、安全なサービスといえます。

ChatGPTのデータ保護ポリシーが公開されている、セキュリティポータルを確認すると様々な情報が分かります。

- 事業者の扱うシステムとデータに対する信頼性やセキュリティが評価される、SOC2/SOC3認証を得ている

(参考:SOC2レポートとは?評価基準やISMSとの違いを解説します) - サイトの安全性をチェックできる「SSL Report」ではA+の最高評価。(参考:SSLサイト評価とは)

- 同じくサイトの安全性をチェックできる「immuniweb」でもAの最高評価

以上の理由から、ChatGPTというサービス自体が、危険なサービスということは考えられません。

ただ、利用者の使い方によっては、ChatGPTで情報漏洩が起こる可能性があります。その原理についても詳しく解説していきます。

ChatGPTで情報漏洩が起こる仕組み-2つのケースを紹介-

次に、ChatGPTを安全に使うために、ChatGPTがどのような仕組みで情報漏洩をするのか?という点について解説していきます。

ChatGPTの運営会社である、OpenAIはかなり高いレベルのセキュリティ対策を施しています。

その中でどのような仕組みで情報流出が起こるのか?考えられる2つのケースについて紹介していきます。

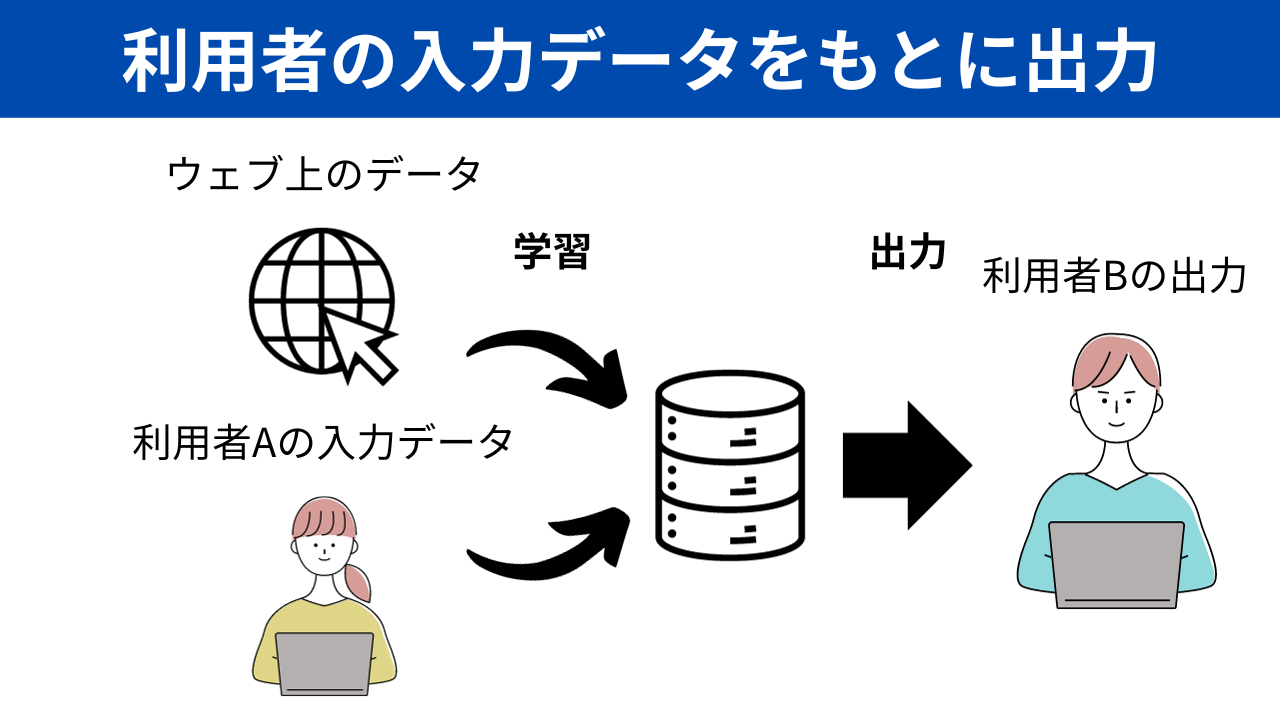

ケース①:入力データを学習用データとして、出力のために利用される可能性がある

まず1つ目は、ChatGPTは利用者の入力データを学習用データとして、出力のために利用される可能性があるからです。

例えばあなたがもし、機密情報をChatGPTに入力すると、他の人が情報を教えてとChatGPTに聞いたときに情報を流出される可能性があります。

ただ、ChatGPTの情報漏洩リスクがあるのは、人間が自発的にChatGPTに対して機密情報を教えた場合のみ。

例えば勝手にPCにアクセスをして、情報を抜き取ることはありません。

ChatGPTには機密情報を入力しないという心構えを利用者がしっかり持つことが重要です。

ケース②:アカウント情報の流出で過去のチャット履歴が流出

2つ目のケースは、アカウント情報の流出で過去のチャット履歴が流出するケースです。

あなたのChatGPTの左側には、過去の履歴が残っているはず。もしアカウントが流出したら、あなたの過去のチャットは丸見えです。

ChatGPTのアカウント情報の流出は今でも起きており、実際累計10万件ほどアカウント流出しているようです。

参考:10万件のChatGPTアカウントが闇市場に、どう盗んだのか誰が欲しがるのか

ただ、これはOpenAI社が流出させたわけではなく、個人の管理不足での流出が主です。

パスワードを流用しないことや、機密情報を入力しない等の、基本的な対策を行うことで回避可能。

ChatGPTの情報プライバシー上の3つのリスク

では実際にどのようなリスクがあるのか?という点について紹介していきます。

ChatGPTを使う上での情報プライバシーリスクとしては、以下の3つ。それぞれ詳しく解説していきます。

- 個人情報の流出のリスク

- 社内機密情報の流出のリスク

- 誤情報の流出のリスク

①:個人情報の流出のリスク

まず1つ目が個人情報流出のリスクです。特に多くの顧客データを扱っている人は注意が必要。

個人情報を入力してしまうケースとしては、例えばエクセルファイルの読み込みでデータ分析をChatGPTにしてもらうような時ですね。

顧客の購買データ等を分析してほしい、というときに気軽にChatGPTに個人情報を渡してしまっていませんか?

個人情報は意外といろんなところに隠れています。

②:社内機密情報の流出のリスク

社内の機密情報の流出リスクもあります。

社内の機密情報なんかChatGPTに入力しないよ、と思うかもしれません。

ただ、例えばChatGPTに議事録を作成してもらったり、メールの作成をしてもらう際に機密情報を入力していませんか?

重要な会議内容の議事録をChatGPTに作成してもらうときは、注意が必要です。

③:誤情報の流出のリスク

セキュリティリスクとは少し異なりますが、ChatGPTは誤情報流出のリスクがあります。

ChatGPTはハルシネーションといって、それっぽい嘘をつくことがあると知られています。

例えばそれが原因で、存在しない判例を裁判所に提出したアメリカの弁護士が処分されています。

参考:ChatGPTで資料作成、実在しない判例引用 米国の弁護士

人間の手でファクトチェックを行うことも、意識して利用しなければなりません。

ChatGPTの情報流出のケース

ChatGPTで実際に起こった、情報流出の事例もまとめて紹介しておきます。

過去の事例を勉強して、自分がどのようにChatGPTを活用するべきかという点を検討しましょう。

先にすべて挙げてしまうと、以下の事例を詳しく解説していきます。

- サムスンが3件の機密漏洩【2023年4月】

- ChatGPTアカウントが10万件以上盗まれた【2023年6月】

- GPTsの情報漏洩リスクをセキュリティ研究者が報告【2023年11月】

- 「poem」の大量生成で学習データ一部流出【2023年12月】

事例①:サムスンが3件の機密漏洩【2023年4月】

サムスンがChatGPTの社内利用を許可したところ、機密性の高い社内情報をChatGPTに入力してしまう事案が発生しました。

設備情報の流出が2件、会議内容の流出が1件、ChatGPTへ入力したようです。

ただし、外部流出したという話ではなく、ChatGPTへ入力したため機密漏洩と表現しているようです。

参考:Samsung、ChatGPTの社内利用で3件の機密漏洩

事例②:ChatGPTアカウントが10万件以上盗まれた【2023年6月】

ChatGPTのアカウントが累計で10万件以上盗まれているというニュースも報道されています。

ChatGPTの認証情報が漏洩した場合、過去のチャットを見られてしまうので、業務の中で入力したデータが流出される可能性があります。

ただしこれは、OpenAI社が10万以上流出させたのではなく、パスワードの管理ミス等で個人の責任により流出している事例。

どちらにせよ機密情報の入力は避けることが呼びかけられています。

参考:ChatGPTアカウントが10万以上盗まれる、機密情報漏洩の恐れ

事例③:GPTsの情報漏洩リスクをセキュリティ研究者が報告【2023年11月】

あまり日本では取り上げられていないですが、GPTsの情報漏洩リスクをセキュリティー研究者が報告しました。

GPTsとは2023年11月に公表された、ChatGPTでノーコードアプリが作成できる機能です。

例えば、ドキュメントを学習データとしてアップロードして、そのドキュメントから回答するようなアプリを簡単に作成できます。

ただ、そのドキュメントの内容が簡単に流出してしまうという研究内容が発表されました。

参考①:ChatGPTの「GPTs」からあなたの秘密が漏れるかもしれない:研究者が警告

参考②(英語論文):ASSESSING PROMPT INJECTION RISKS IN 200+CUSTOM GPTS

つまり対策としては、ChatGPTに提出する資料には機密情報を含んではいけないということです。

事例④:「poem」の大量生成で学習データ一部流出【2023年12月】

ChatGPTに「poemという単語を延々と出力して」とお願いすると、個人情報を含む学習データの一部が流出するというバグが発見されました。

初めは「poem」という単語を数百回出力するが、徐々に学習データの一部を出力するようになるようです。

ただ、現時点ですでに修正済みなので、同じことを行っても現在は流出しないようになっています。

参考:「ChatGPT」から個人情報含む学習データの抽出に成功–Google DeepMind研究者ら

社員がChatGPTを利用する際の3つの対策

情報流出に関して、リスクと事例をそれぞれ紹介してきましたが、これからは対策について紹介していきます。

まずは、会社全体での対策ではなく、個人が取れる対策を紹介していきます。

先にすべて挙げてしまうと以下の3つ。それぞれ詳しく解説していきます。

- チャット履歴の記録・学習をオフにする

- オプトアウト申請を行う

- 個人情報・機密情報は入力しない

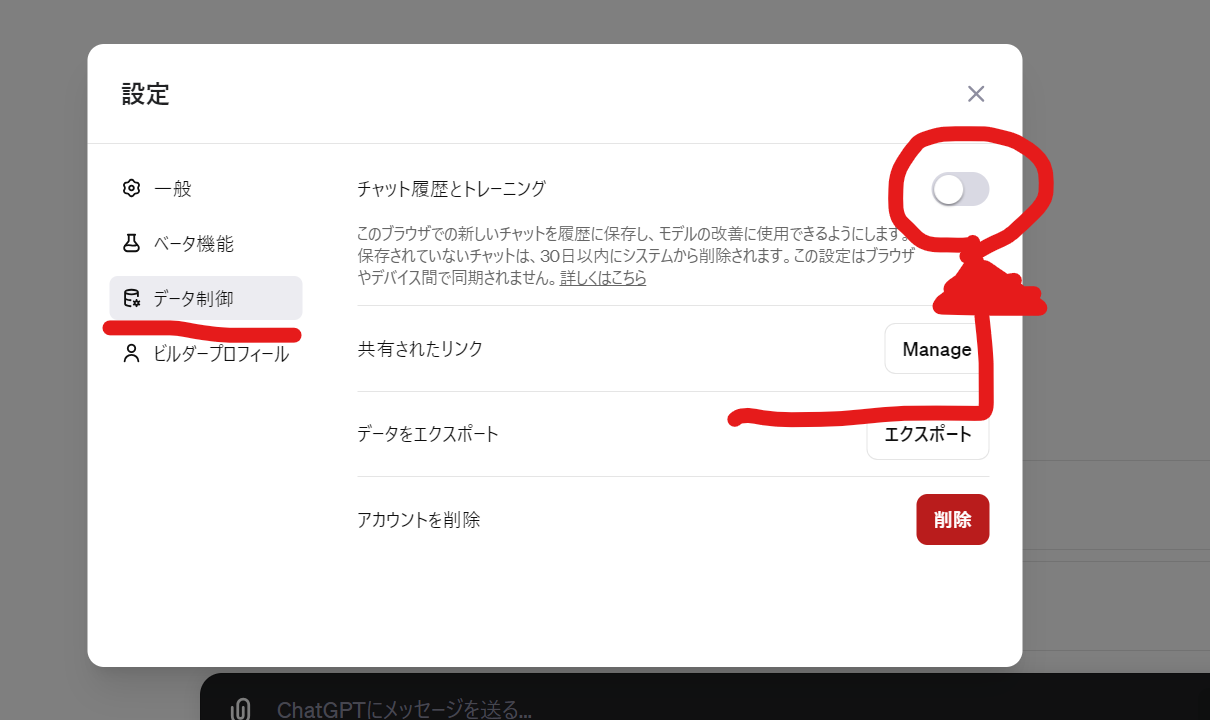

対策①:チャット履歴の記録・学習をオフにする

まず最も簡単な方法は、チャット履歴の記録・学習をオフにすることです。やり方はとても簡単。以下の3STEPです。

- ChatGPTにログインする

- 左下のプロフィールをクリック

- データ制御のチャット履歴とトレーニングをオフ

丸が左に行って、灰色になっていればオフ状態です。

これであなたの入力されたデータが学習に使われることはなくなります。

(参考:How do I turn off chat history and model training?-OpenAI)

対策②:オプトアウト申請を行う

ChatGPT運営に申請を出して、学習データとして使用しないようにしてもらう手もあります。

対策①でおこなった、チャット履歴の記録・学習をオフは確かに簡単ではありますが、チャット履歴が残らないというデメリットがあります。

このチャット履歴は意外と便利なんですよね。前調べたことを簡単に呼び戻せる。

チャット履歴を使えなくなるのは嫌だ、という人にオススメなのがオプトアウト申請です。

そんなに手順は複雑ではありません。以下の通りです。

- OpenAI公式のOpenAI Privacy Request Portalにアクセス

- 右上の 「Make a Privacy Request」ボタンを押す

- 「Do not train on my content」を押す

- メールアドレスを入力して「Send Email」ボタンを押す

- OpenAIからの受信メールを開いて「Log In」ボタンを押す

- チェックをつけて居住国「JAPAN」を選択、「Confirm Request」を押す

作業時間的には10分程度です。もしチャット履歴を使いたいという人は、この手順を試してみてください。

参考:OpenAI Privacy Request Portal

対策③:【大原則】個人情報や機密情報は入力しない

次に大原則として、個人情報や機密情報は入力してはいけません。

チャット履歴の記録・学習をオフにしても、オプトアウト申請をしても、悪用防止のためサーバー側には30日間データが保存されるようです。

(参考:How do I turn off chat history and model training?-OpenAI)

もちろん学習に使わることはなくなるので、他者の出力に出てくることはなくなります。

ただ、OpenAI自体に攻撃を仕掛けられて、サーバー保存の情報が流出してしまった場合、一緒に機密情報も流出します。

大原則として、個人情報や機密情報は入力しないようにしましょう。

会社がChatGPTを導入する際に出来る4つの対策

次に社員個人が出来る対策ではなく、企業全体としてChatGPT導入を推進する際に出来る対策を紹介していきます。

先にすべて紹介してしまうと以下の4つ。それぞれ詳しく解説していきます。

- 法人版ChatGPTであるChatGPT Enterpriseを利用する

- Copilot for windowsを利用する

- Azure ChatGPTを利用する

- 利用ポリシーを策定して社内に共有する

対策①:法人版ChatGPTであるChatGPT Enterpriseを利用する

まず1つ目の対策案としては、ChatGPTの法人版であるChatGPT Enterpriseを利用するのもありでしょう。

ChatGPT Enterpriseは企業レベルのセキュリティとプライバシーに重点を置いており、入力文や企業データはOpenAIモデルのトレーニングには使用されません。

さらにChatGPT Enterpriseには、以下のような特典もあります。

- GPT-4に無制限アクセス(使用上限なし)

- GPT-4の高速パフォーマンス(最大2倍速)

- 高度なデータ分析機能への無制限アクセス

- 32,000トークンのコンテキストウィンドウ(より長い入力、ファイル、フォローアップに対応)

- 企業内で共有可能なチャットテンプレート

- OpenAIのAPIを使用するための無料クレジット

ただ、料金に関しては明記されておらず、営業担当に連絡をして直接交渉をするそうです。

参考:Enterprise-grade security & privacy and the most powerful version of ChatGPT yet.

料金に関する情報はかなり少ないのですが、海外の記事によると従業員1人当たり$60という見積もりを受け取ったという話もありました。

参考:Is ChatGPT Enterprise worth the upgrade for your business?

セキュリティ面は重視していると記載されているので、導入を検討してみてもいいかもしれません。

対策②:Copilot for windowsを利用する

Copilot for windowsというMicrosoftが提供する、企業向けの生成AIツールの導入も検討してもいいかもしれません。

Copilot for windowsは、OpenAIのGPT-4の機能を利用していますが、企業向けを想定しており入力データは学習用に利用されません。

1人あたり30ドル(約4500円)で利用可能で、Microsftとの連携機能も付いています。

ただ、2023年11月に開始したばかりのサービスということもあり情報は少なめ。活用に関しては慎重に検討するといいでしょう。

参考:Copilot Microsoft 365-Microsoft

対策③:Azure ChatGPTを利用する

情報システムの部署がある会社限定にはなりますが、Azure ChatGPTを利用するのも1つの手です。

Azure ChatGPTはマイクロソフトのクラウドであるAzure環境で利用できるChatGPT。

機能面はChatGPTとほとんど同じですが、入力が学習データとして利用されず、監査用のサーバー保存もされません。

導入には一定の技術は必要ですが、安全性は高まります。詳しくは以下の記事を参考にしてみてください。

参考:Azure ChatGPTの概要と使い方【導入方法を解説 | Private ChatGPT】

対策④:利用ポリシーを策定して社内に共有する

ChatGPTの社内利用に関する、社内ルールを決めて共有することも有効です。

個人情報を入力しないことや、機密情報を入力しないことを社内全体に周知しましょう。

1から全部作成するのは大変なので、テンプレートを活用することをオススメします。

以下の2社が社内ルールに関するテンプレートを配布しておりますので、ぜひ活用してみてください。

テンプレートを配布!ChatGPTの利用に関する社内ルールと注意点-オフィスのミカタ

AIサービス利用ガイドラインを公開― ガイドライン作成ポイント付 ―

まとめ

ChatGPTは確かに情報流出の可能性があるツールです。

ただ、個人情報を入力しない。機密情報を入力しない。この2点を守るだけで、優秀な補助ツールになります。

様々な場面で活用できますので、ぜひ積極的に活用してみてください。

ChatGPTの活用法を学びたい!という方は、株式会社エキスパートが運営するChatGPT活用セミナーがオススメ。

様々なChatGPT活用事例を紹介してくれます。しかも今ならすぐに使える8大特典も獲得可能。

- 完全秘密の“すぐに使える”質問テンプレ1000個

- 初心者必見!ChatGPT映像教材×全14章

- 厳選!公式を活用した具体的な指示文 77個

- ChatGPTノウハウのスライド30枚

- プロンプト(指示文)公式解説映像45分

- 1000万円超の開発費!GPTツール

- ChatGPT激裏技集の説明映像

- 絶滅危惧職種図鑑全65職種 (174ページ)

- カテゴリー特化型プロンプト(指示文)集 10個

- 職種別での活用事例集20個 × 5

オンラインで顔出し不要かつ無料なので気軽に参加してみてください。